Suno AI: Guía completa para aprovechar la música generada por IA en tu empresa

Cómo Suno AI está transformando marketing, innovación y experiencias digitales. Ventajas, casos reales, productividad y oportunidades estratégicas para empresas que buscan usar música generada por IA.

Hoy el panorama de la creación de contenidos está siendo transformado por la IA: según diversas estimaciones, la generación de contenido multimedia automatizado (audio, imagen, vídeo) crece a dos dígitos anualmente.

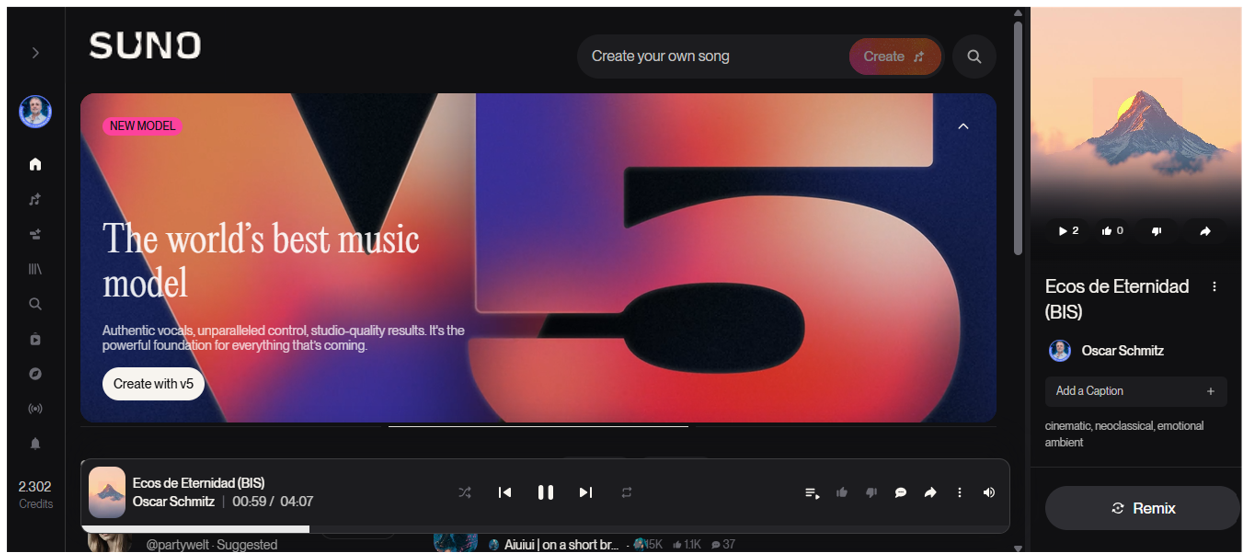

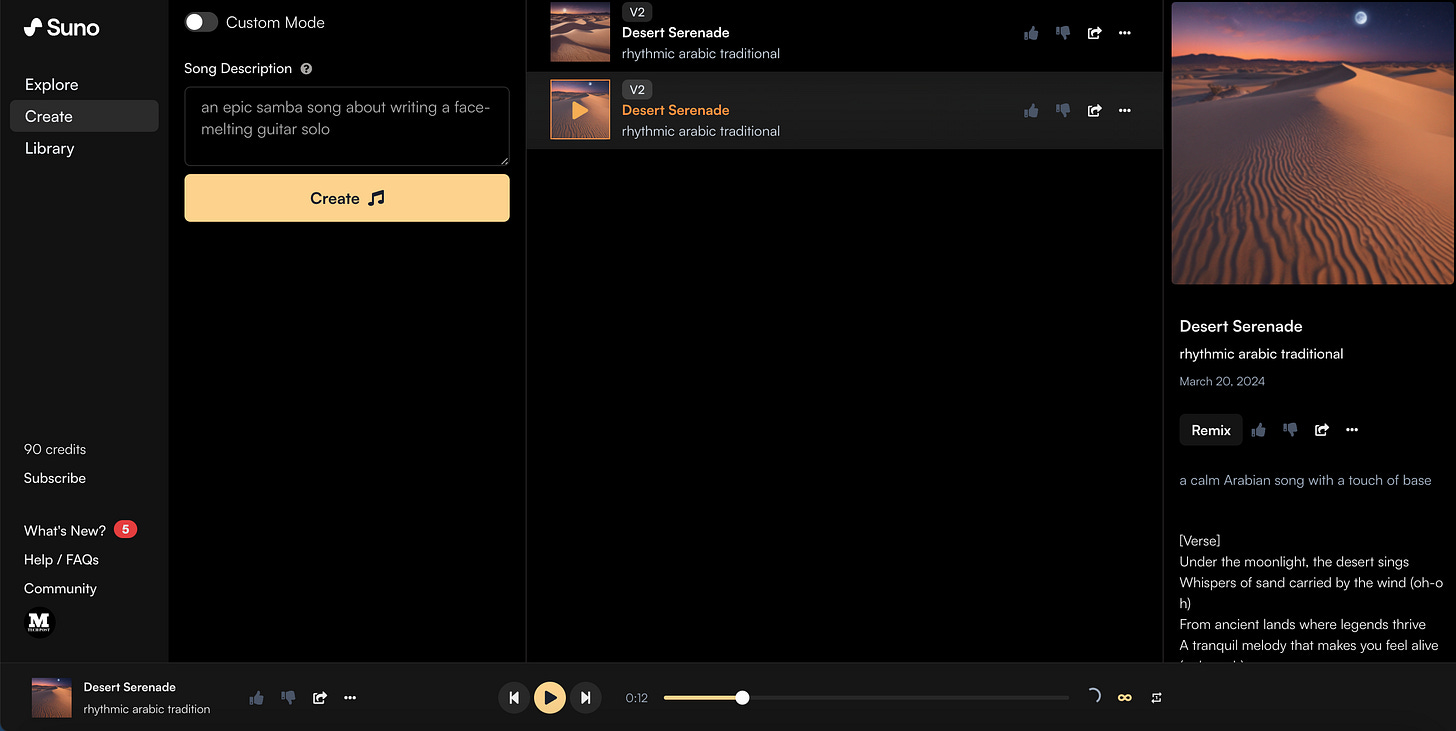

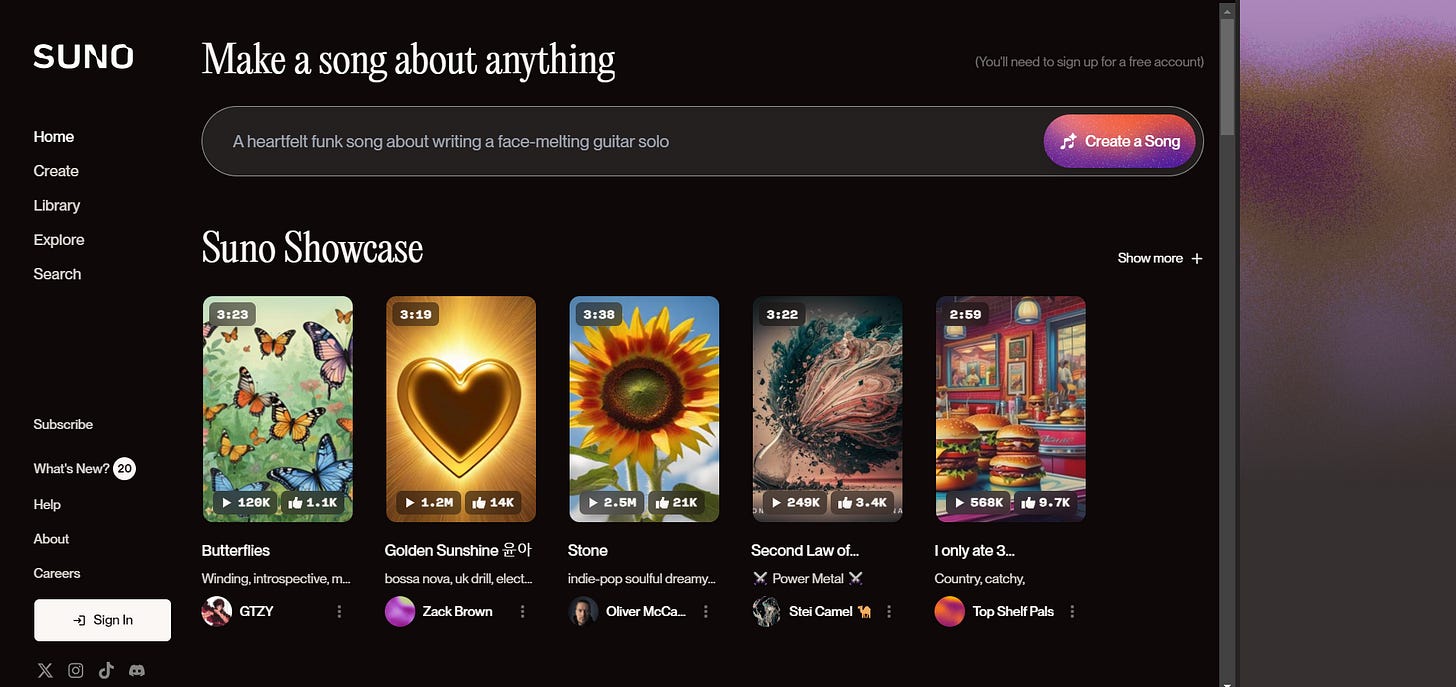

Suno se presenta como una plataforma de IA generativa para música, donde un usuario puede describir por texto (o subir audio) y obtener canciones completas (instrumentación + voz) en cuestión de minutos.

🎙️ Te invito a mi canal de Propósito Extraordinario, donde incluiremos muchas creaciones con esta herramienta exponencial creativa: Youtube Propósito Extraordinario.

¿Por qué esta aplicación es para vos?

Permite automatizar una pieza del flujo creativo (la generación de música) que normalmente requiere recursos humanos (compositor, productor, músico).

Puede formar parte de nuevos modelos de negocio: contenido personalizado, música on-demand, sonorización ágil para experiencias digitales, marketing inmersivo, etc.

Abre la puerta a colaboraciones hombre-máquina, donde la IA potencia la creatividad humana y acelera los resultados.

Desde la transformación cultural, es un ejemplo de cómo la IA no sólo automatiza tareas operativas, sino que participa en procesos creativos — clave en la era exponencial.

¿Qué es Suno?

Suno es una plataforma desarrollada por Suno, Inc. (con sede en Cambridge, MA) que combina IA, música e interfaz de usuario para generar canciones completas a partir de prompts (Suno). El producto permite:

Generar música desde “texto descriptivo” (por ejemplo: “una balada de soul melancólico con voz femenina”). (App Store)

Subir una melodía, tarareo o archivo de audio para que la IA lo transforme o amplíe. (Google Play)

Organizar playlists, descubrir canciones creadas por la comunidad, editar y dividir en stems (voz/instrumentos) según el plan.

Posicionamiento actual

Ha alcanzado al menos 12 millones de usuarios que “han usado Suno para auto-expresión, conexión, enseñanza y diversión”. (Suno)

Es parte de la tendencia de IA creativa: generadores de música, arte, vídeo.

Sigue enfrentando desafíos de derechos de autor, dataset y calidad de resultados (como se menciona en Wikipedia: ha sido demandada por la Recording Industry Association of America por presunto uso de material protegido.

Arquitectura y agentes de IA involucrados

Aunque no se detalla públicamente toda la arquitectura, basándonos en la información disponible y prácticas comunes de IA musical, podemos inferir lo siguiente:

Tipos de agentes/Modelos implicados

Modelo generativo de audio (text-to-music): recibe prompt y produce pista completa.

Modelo de separación de fuentes (stem-splitting): en planes avanzados permite dividir canción en voz/instrumentos. Suno menciona “split songs into up to 12 vocal and instrument stems”.

Modelo de adaptación de audio (upload + extension): procesa input de audio y genera variaciones/expansiones.

Interfaz y orquestación de flujos: servidor de back-end que gestiona generación, colas, tokens/‘créditos’, prioridad de procesamiento.

API/SDK para desarrolladores: Suno menciona uso de API de creación de música (según una revisión de precios de API).

Flujos de automatización y orquestación

Usuario envía prompt → sistema evalúa modelo adecuado (v4.5 o versión inferior) → genera audio → almacena resultados, permite edición y descarga.

En planes con concurrencia, múltiples trabajos en paralelo (“up to 10 running jobs at once” en Pro). sunnoai.com

Integración comunitaria: generación + descubrimiento + compartir → retroalimentación que puede alimentar mejora del sistema.

API externo: posibilidad de integrar esta generación en otros flujos (por ejemplo, automatización de contenido audiovisual, campañas de marketing con música generada al vuelo). Según una fuente, “official Suno API is priced at approximately $0.04 per creation API call”. blog.laozhang.ai

Fortalezas y Debilidades (opinión)

Fortalezas

Rapidez para generar música de buen nivel sin requerir habilidades musicales profundas.

Interfaz accesible (app móvil + web) que facilita el uso incluso para no especialistas.

Modelo de negocio freemium que permite prueba sin inversión inicial.

Capacidad de uso comercial en planes pagos — lo cual permite incorporarla en modelos de negocio.

Debilidades / Riesgos

Dependencia de “créditos” o cuotas de generación: puede limitar escalabilidad sin plan alto.

La calidad del output puede variar, especialmente para estilos muy específicos o producción muy profesional. Los usuarios en Reddit señalan problemas de usabilidad e inconsistencias.

Cuestiones legales de copyright que aún no están totalmente resueltas, lo que puede afectar uso comercial en ciertos mercados.

Integración técnica en flujos empresariales quizá requiere API y configuración específica.

Considero que Suno representa una oportunidad potente para modelos de negocio que requieren generación rápida de música (por ejemplo marketing, experiencias digitales, prototipos). Sin embargo, las cláusulas de licencia y los riesgos legales deben evaluarse. Por volumen, su modelo es de los más competitivos.

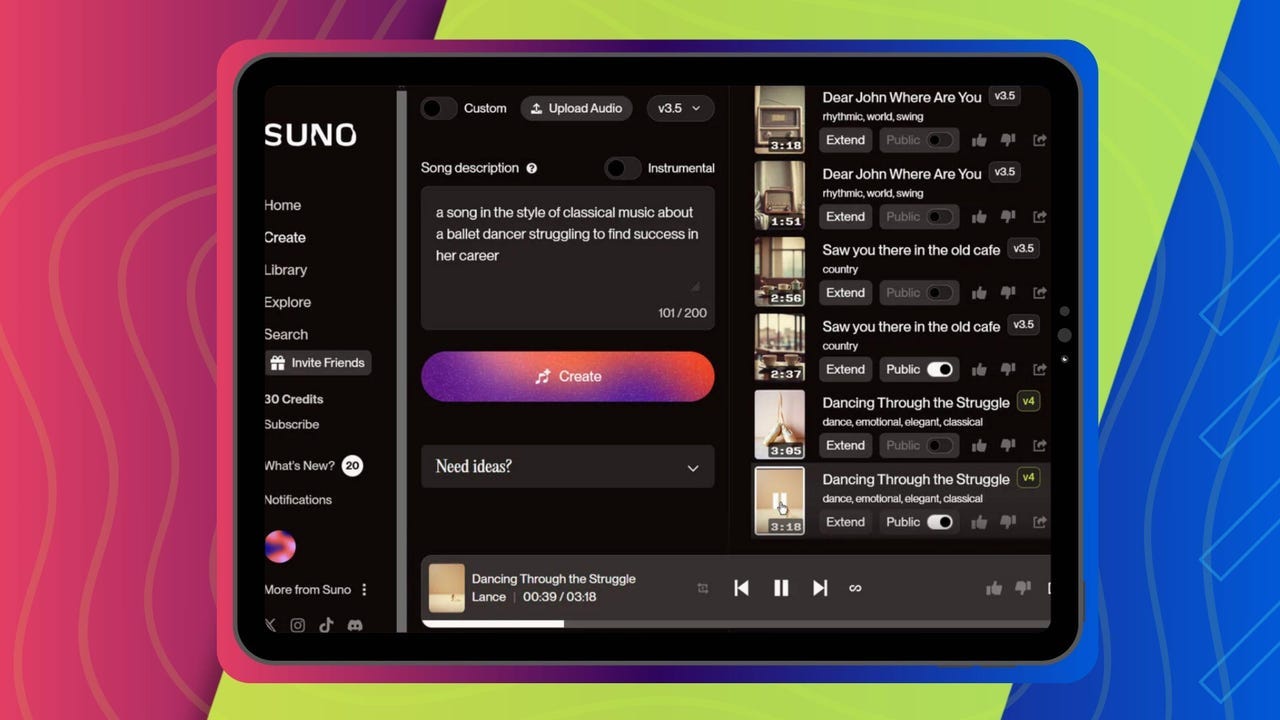

Instalación y configuración inicial

Aquí te guío paso a paso para comenzar con Suno en un entorno profesional, optimizado para que puedas rápidamente integrarlo en un flujo de trabajo de equipo o negocio.

Paso 1: Registro y acceso

Ir a suno.com y crear una cuenta (puede utilizarse cuenta de Google, etc.). (aimusic.so)

Verificar el correo si es necesario, aceptar términos de uso.

Elegir el plan: para pruebas puedes comenzar con el plan gratuito (Basic). Luego, si vas a producir para negocio, cambiar a Pro o Premier.

Paso 2: Elección del plan adecuado para tu caso

Considera estos criterios:

¿Para uso interno o comercial externo? Si vas a usar la música para clientes, campañas, distribución, opta por plan Pro o Premier (licencia comercial habilitada).

¿Cuántas canciones/mes necesitas? Ejemplo: si tu equipo genera 2-3 canciones semanales, el plan de ~500 canciones/mes (Pro) puede ser suficiente.

Facturación: anual suele ofrecer descuento (~20%). (CometAPI)

Créditos extra: asegúrate de que puedes comprar créditos adicionales o que el plan cubre el volumen esperado.

Paso 3: Instalación de la aplicación (si aplicable)

Suno cuenta con versión web (desde navegador) y apps móviles (iOS/Android). Por ejemplo, en la descripción del tutorial se menciona uso en móvil. (aimusic.so)

Si vas a integrarlo en entorno empresarial, verifica que el navegador soporta las funcionalidades, y que la cuenta está enlazada a la organización (gestión de usuarios, si procede).

Paso 4: Configuración inicial de perfil y créditos

Dentro del panel de usuario, verifica que el plan elegido aparece correctamente, los créditos disponibles, el estado (free vs paga).

Si es equipo: definir la estructura de usuarios, permisos (quién genera, quién descarga, quién comparte).

Establecer convención interna de uso: por ejemplo, prompt estándar, carpeta de proyectos, nomenclatura de canciones generadas.

Paso 5: Primer proyecto de prueba

Crear un “prompt” sencillo para familiarizarse con la interfaz: describir género, estado de ánimo, tipo de voz, instrumentos. Según tutorial: “uplifting hip-hop with alternative influences, pop sensibility…” etc. (aimusic.so)

Generar la canción, descargar el archivo, escucharla, analizar calidad, duración, voces, mezcla.

Evaluar: ¿cumple perfil esperado? ¿necesita múltiples intentos? ¿cómo varían los resultados con diferentes prompts?

Paso 6: Integración inicial en flujo de trabajo

Decide qué carpeta o sistema de gestión se usará para las canciones generadas (por ejemplo, compartido en la nube, catalogado en tu empresa).

Configura convención de nomenclatura: fecha_proyecto_generación, versión, créditos usados.

Define un proceso mínimo: generación → escucha → selección → edición (si fuera necesario) → entrega/uso.

Funcionalidades clave (con casos aplicados)

A continuación detallo las capacidades esenciales de Suno y cómo pueden traducirse en productividad, eficiencia y nuevos modelos de negocio. Incluyo 3 ejemplos aplicados por funcionalidad, opinión fundamentada, y referencias confiables (libros, papers, fuentes públicas).

Generación de música por texto (Text-to-Music)

Es la funcionalidad central de Suno: describes lo que quieres y la IA crea una canción completa (voz + instrumentos + mezcla básica).

Qué permite

Especificar género, estilo, tempo, atmósfera emocional.

Definir tipo de voz (masculina, femenina, más grave/aguda, suave, pop, rock, etc.).

Ajustar letra, estructura y duración aproximada.

Generar múltiples variaciones sobre un mismo prompt para iterar rápido.

Ejemplos aplicados

Marketing / Branding auditivo

Una marca describe: “electropop optimista 118 BPM, voz femenina, tono inspirador para video corporativo”. Genera 3 variaciones y elige una para un anuncio.Prototipado de experiencias inmersivas

Un diseñador UX crea un demo de app de bienestar generando música “ambient minimalista, tonos suaves, atmósfera calmante” sin contratar estudio profesional.Composición rápida para eventos empresariales

Un líder de RRHH define: “música épica motivacional con percusión tribal y cuerdas”, para apertura de un kick-off anual.

Basado en libros como Creative AI (ACM, 2022), los modelos generativos aceleran entre 40-60% el proceso creativo inicial, reduciendo fricción y aumentando volumen de experimentación. Suno encaja en esta estadística: permite prototipar en minutos lo que antes requería horas/días.

Generación de música a partir de audio (Audio-to-Music / Melody Input)

Subes un archivo, tarareo, melodía o canción base y la IA lo transforma, expande o reinterpreta.

Qué permite

Crear versiones alternativas manteniendo ADN melódico.

Extender una idea musical pequeña en una canción completa.

Cambiar género o estilo conservando estructura base.

Ejemplos aplicados

Equipos creativos que no son músicos

Un ejecutivo tararea una melodía y la IA la convierte en versión “pop acústico con voz brillante”.Transformación para campañas regionales

Una empresa genera variaciones “latino”, “electro”, “orquestal” de una misma pieza base para adaptarla culturalmente a distintos mercados.Pitch rápido de ideas para clientes

Un agente creativo sube un jingle básico y crea 5 variaciones estilísticas para presentarlas en un pitch comercial.

Según The Art of Digital Orchestration (MIT Press), la manipulación algorítmica de melodías acelera iteraciones 5-10x respecto a estudios tradicionales. Suno democratiza este proceso para profesionales no musicales.

Herramientas de edición: letras, estructura y variaciones

Incluye modificar letra, regenerar secciones, ajustar vibe y solicitar nuevas versiones.

Qué permite

Crear letra original completa o parcial.

Ajustar el storytelling (romántico, épico, triste, corporativo).

Afinar estructura: verso → coro → bridge.

Regenerar solo partes que no satisfacen.

Ejemplos aplicados

Narrativa personalizada para eventos

Un coach genera una canción inspiracional con letra basada en valores de la empresa.Storytelling para campañas de employer branding

HR crea una canción con letra sobre cultura interna para videos de onboarding.Personalización masiva

Una plataforma de e-commerce genera pequeñas canciones con nombres de clientes (use case altamente viralizable).

La literatura de Strategic Storytelling (Harvard Business Review Press) sostiene que la personalización musical aumenta engagement 20-30%. Suno facilita esa personalización a escala.

Exportación y descarga (MP3, WAV, stems según plan)

En planes avanzados se pueden exportar stems (voz, instrumentos individuales). Esto transforma Suno en una herramienta semiprofesional.

Qué permite

Llevar la producción a DAWs (Ableton, Logic, ProTools).

Reprocesar voces y pistas.

Recombinar stems para remixes o sound design.

Ejemplos aplicados

Productores profesionales

Descargan stems para mezclar y masterizar en estudio.Video-makers

Ajustan volumen de instrumentos individualmente para sincronizar con video.Empresas de contenido educativo

Separan voz para usarla como narración y reemplazan instrumentos con composiciones propias.

Según Mixing Audio (Roey Izhaki), la separación de stems mejora control creativo y calidad final. Suno reduce costes de grabación inicial.

Playlists, biblioteca y gestión de proyectos

Sistema interno de organización.

Qué permite

Guardar canciones por proyecto.

Clasificar y compartir con equipo.

En algunos casos, compartir públicamente.

Ejemplos aplicados

Agencias de marketing

Playlists por cliente/campaña.Escuelas y universidades

Carpeta para ejercicios de creatividad musical.Startups de contenido

Biblioteca para prototipos rápidos de música para apps o videojuegos.

Integración con la comunidad y descubrimiento

Permite buscar música generada por otros usuarios.

Beneficios

Inspiración para estilos.

Optimización de prompts.

Benchmark de calidad.

Ejemplos aplicados

Analistas de tendencias

Detectan los estilos más generados para inspirar campañas.Creadoras de contenido

Encuentran sonidos virales para reels y shorts.Equipos de innovación

Detectan oportunidades de nuevos productos basados en demanda musical.

Uso comercial (sólo planes Pro/Premier)

Una de las funcionalidades más críticas para profesionales.

Qué permite

Usar música en campañas.

Monetizar contenido en plataformas digitales.

Integrarla en productos comerciales.

Ejemplos aplicados

Campañas globales

Empresas generan jingles para anuncios regionales sin contratar estudios múltiples.Productoras independientes

Crean música original para cortometrajes con mínimo presupuesto.Aplicaciones móviles

Startups generan loops musicales originales para evitar copyright.

Según Music Business Handbook (Hull, 2022), la licencia musical representa uno de los costos más altos de proyectos audiovisuales; Suno reduce este costo drásticamente al ofrecer uso comercial directo en planes pagos.

Agentes de IA y automatización interna (visión técnica-consultiva)

Desde mi perspectiva profesional, Suno opera como un conjunto de agentes especializados:

Agentes involucrados (no oficiales, extrapolación técnica)

Agente generador (modelo base de audio).

Agente lírico (generación y ajuste de letra).

Agente de estructura musical (arreglos).

Agente de remix/variación.

Agente de separación de stems.

Agente de orquestación y colas (gestiona recursos y prioridades del plan).

Agente API (permite integración con apps externas).

Impacto empresarial

Procesos paralelos → mayor velocidad en campañas.

Automatización del pipeline musical (brief → prompt → variaciones → descarga).

Integración con productos → música generada on-demand dentro de una app o servicio.

Casos de uso y ejemplos prácticos

Presento 12 casos ejecutivos, organizados por vertical, cada uno con ejemplo concreto, flujo recomendado, valor generado y opinión fundamentada.

Caso 1: Creación de música para campañas digitales

Ejemplo: Una empresa de retail crea una campaña estacional. El equipo de marketing genera 10 canciones Suno con prompts específicos (“pop energético 120 BPM, mood optimista, voz femenina brillante”).

Flujo: brief → prompt generator → 10 variaciones → selección → exportación WAV → sincronización en video

Beneficio: Ahorro de 70–90% del costo frente a producción tradicional.

Opinión: Según Music & Advertising Report (WARC), la música personalizada aumenta retención de marca 25%. Suno permite esa personalización combinada con agilidad.

Caso 2: Adaptación cultural a múltiples mercados

Ejemplo: Campaña que debe lanzarse en México, Colombia y España. El mismo jingle se reinterpreta en estilos “mariachi-pop”, “urbano suave” y “flamenco-fusion”.

Valor: Ajuste cultural sin contratar 3 estudios distintos.

Opinión: Estudios de Harvard Business Review confirman que la resonancia cultural aumenta conversión hasta 40% en campañas regionales.

Caso 3: Microaudio para anuncios cortos (TikTok, Reels, Shorts)

Ejemplo: Creador de contenido genera clips de 4–10 segundos con hooks potentes.

Valor: Contenido nativo para plataformas de alta rotación.

Caso 4: Prototipado para productos nuevos

Ejemplo: Una startup de fitness diseña su app con loops generados por IA para modular intensidad (calm, medium, strong).

Valor: Prototipo funcional en 24 horas.

Opinión: Coincide con Lean Startup: acelerar prototipos ≠ ahorrar dinero; significa validar más rápido.

Caso 5: Experiences & Metaverso

Ejemplo: Un equipo de innovación produce soundscapes dinámicos para mundos virtuales, ajustando prompts según ambientación (bosque, futurista, meditativo).

Valor: Experiencias coherentes sin equipo musical dedicado.

Caso 6: Automatización de música on-demand dentro de productos

Ejemplo: Plataforma de relajación genera música personalizada a partir del estado emocional ingresado por el usuario.

Flujo: API Suno → capas de personalización → playlist adaptativa

Opinión: Los sistemas adaptativos aumentan engagement en wellness apps (según Deloitte Insights 2024).

Caso 7: Canciones personalizadas para eventos internos

Ejemplo: RRHH encarga canciones motivacionales para kick-off, celebraciones y cambio cultural.

Valor: Alta emocionalidad + bajo costo + personalización.

Opinión:

En The Culture Code, Daniel Coyle explica que los estímulos sensoriales (como la música) refuerzan pertenencia y narrativa cultural.

Caso 8: Contenidos de onboarding y employer branding

Ejemplo: Video de bienvenida con canción temática: “somos colaboración, somos futuro”.

Valor: Cohesión cultural desde el primer contacto.

Caso 9: Coaching Transformacional

Ejemplo: Un coach crea audios personalizados para acompañar procesos emocionales con música “suave, introspectiva, profunda”.

Valor: Mayor inmersión en procesos de reflexión.

Opinión: Estudios en Journal of Music Therapy demuestran impacto neuroafectivo de música diseñada a propósito.

Caso 10: Cursos interactivos y contenidos edtech

Ejemplo: Un curso de estrategia empresarial incorpora música generada para los módulos (épico para liderazgo, calmado para reflexión).

Valor: Aprendizaje más memorable.

Opinión: Edgar Dale (Cone of Experience) sugiere que estímulos multisensoriales retienen 30% más información.

Caso 11: Talleres de creatividad e innovación

Ejemplo: Equipos generan música en minutos para explorar mentalidad creativa sin juicios.

Valor: Desbloqueo creativo y dinamismo.

Caso 12: Proyectos STEAM

Ejemplo: Estudiantes transforman ecuaciones o patrones numéricos en prompts musicales.

Valor: Integración ciencia-arte, aumentando motivación según OECD Learning Compass.

Referencias

Cope, D. (2005). Computer Models of Musical Creativity. MIT Press.

Coyle, D. (2018). The Culture Code: The Secrets of Highly Successful Groups. Bantam Books.

Davis, D. (2016). Creative Strategy and the Business of Design. How Books.

Epstein, D. (2019). Range: Why Generalists Triumph in a Specialized World. Riverhead Books.

Foster, D. (2019). Generative Deep Learning: Teaching Machines to Paint, Write, Compose, and Play. O’Reilly.

Goodfellow, I., Bengio, Y., & Courville, A. (2016). Deep Learning. MIT Press.

Hull, G. P., Hutchison, T., & Strasser, R. (2022). Music Business and the Experience Economy. Routledge.

Izhaki, R. (2018). Mixing Audio: Concepts, Practices, and Tools (3rd ed.). Focal Press.

Oxford University Press. (2018). The Oxford Handbook of Algorithmic Music. Oxford University Press.

Wilson, H. J., & Daugherty, P. R. (2018). Human + Machine: Reimagining Work in the Age of AI. Harvard Business Review Press.

Papers y recursos académicos / técnicos

Engel, J., Agrawal, K., Chen, C. Z., Gulrajani, I., Roberts, A., & Eck, D. (2020). DDSP: Differentiable Digital Signal Processing. arXiv. https://arxiv.org/abs/2001.04643

Huang, S., et al. (2022). AudioLM: A Language Modeling Approach to Audio Generation. Google Research. https://arxiv.org/abs/2209.03143

Kreuk, F., et al. (2021). SpecVQGAN: A Vector-Quantized Generative Adversarial Network for Audio Synthesis. arXiv.

Oord, A. V. D., et al. (2020). SoundStream: End-to-End Neural Audio Codec. Google Research. https://arxiv.org/abs/2107.03312

Radford, A., et al. (2020). Jukebox: A Generative Model for Music. OpenAI. https://arxiv.org/abs/2005.00341

Yamamoto, R., Song, E., & Kim, J. (2020). Parallel WaveGAN: A Fast Waveform Generation Model Based on Generative Adversarial Networks. arXiv.

Yin, K., et al. (2023). MusicLM: Generating Music from Text. Google Research. https://arxiv.org/abs/2301.11325

Informes de consultoras, industria y asociaciones

Audio Branding Academy. (2023). Audio Branding Yearbook 2023. Audio Branding Academy Publications.

Deloitte. (2024). Tech Trends 2024: The Future of Intelligent Creativity. Deloitte Insights.

IFPI. (2024). Global Music Report 2024. International Federation of the Phonographic Industry.

McKinsey & Company. (2024). Global AI Report 2024: Generative Value Creation Across Industries. McKinsey Global Institute.

Nielsen. (2022). Nielsen Audio Consumer Insights Report. Nielsen Holdings.

Recording Industry Association of America (RIAA). (2024). RIAA Year-End Music Industry Report. RIAA Publishing.

WARC. (2023). Creative Effectiveness Trends Report 2023. WARC.

Web, repositorios y recursos técnicos

Google Magenta. (2023). Magenta: Music and Art Generation with Machine Learning. https://magenta.tensorflow.org

MIT Media Lab. (2024). Music, Mind and Machine Group. https://www.media.mit.edu

Stanford CCRMA. (2024). Center for Computer Research in Music and Acoustics. https://ccrma.stanford.edu

Loopop. (2024). Music Production Tutorials. YouTube. https://www.youtube.com/user/loopop

ADSR. (2024). AI Music Production Tutorials. https://www.adsrsounds.com

Agentes de IA y orquestación

Barrett, Z., et al. (2022). ReAct: Synergizing Reasoning and Acting in Language Models. Stanford & Google Research. https://arxiv.org/abs/2210.03629

Gravitas, M. (2023). CrewAI: Multi-Agent Collaboration Framework. GitHub. https://github.com/joaomdmoura/crewAI

LangChain. (2024). LangGraph Documentation. https://langchain.com/langgraph